L’essentiel à retenir : la maîtrise stratégique de la donnée exige un arbitrage rigoureux entre l’exclusivité brute des sources primaires et l’efficience des gisements secondaires. Pour conjurer le chaos décisionnel, la représentativité statistique et l’éthique du RGPD s’imposent comme des remparts vitaux. Seule l’automatisation des flux via des outils comme QuestionPro garantit une souveraineté informationnelle durable.

Les organisations qui survivent dans l’économie de la donnée partagent un trait commun : elles transforment le chaos informationnel en architecture de certitudes. Une donnée primaire, captée à la source avec une précision chirurgicale, offre un avantage concurrentiel souverain que les gisements de données secondaires ne sauraient égaler sans un examen critique de leur obsolescence.

Pourtant, une méthodologie défaillante ou un échantillonnage corrompu condamnent vos analyses à n’être que des mirages statistiques. Nous allons décortiquer les data collection techniques pour ériger un système de capture infaillible, garant de la survie de vos projets dans un environnement saturé d’incertitudes.

Fondations de l’intelligence : le socle des données primaires et secondaires

La collecte de données repose sur l’arbitrage entre sources primaires et secondaires. Les questionnaires quantitatifs et entretiens qualitatifs forment l’ossature d’une stratégie fiable, à condition de garantir un échantillonnage représentatif pour préserver la pureté de l’information.

Cette quête de pureté nous mène inévitablement à la source même du savoir, là où l’information n’a pas encore été altérée par des tiers.

Suprématie des données primaires : la conquête de l’information brute

La donnée primaire se capte directement à la source. Elle offre une exclusivité totale face à la concurrence. C’est un avantage stratégique pour votre organisation.

L’effort de collecte est réel. Pourtant, la pureté du savoir obtenu justifie cet investissement en temps et ressources.

Le contrôle du protocole est total. Vous évitez ainsi les biais des études tierces souvent obsolètes.

Richesse des données secondaires : l’exploitation des gisements existants

Les bases de données existantes accélèrent la prise de décision. Elles limitent les coûts de recherche initiaux. C’est une mine d’or souvent sous-exploitée.

Il faut identifier des sources fiables. Les rapports sectoriels ou les archives publiques sont d’excellents points de départ pour vos analyses.

Attention toutefois à l’obsolescence. Une donnée datée peut fausser vos projections les plus sérieuses. Soyez vigilant.

Échantillonnage et représentativité : la quête de la vérité statistique

La sélection du panel détermine la validité des résultats. Un échantillon trop petit mène à des conclusions hâtives. La représentativité est votre bouclier contre l’erreur.

Définissez une taille critique minimale. Sans cela, vos analyses risquent de s’effondrer face à la réalité du terrain. Ne l’oubliez jamais.

Un mauvais ciblage ruine l’intégrité de l’étude. Ne négligez jamais cette étape avant de lancer vos data collection techniques.

Méthodes quantitatives : la rigueur des chiffres face au chaos

Les fondations théoriques posées, la mesure concrète s’impose pour quantifier les comportements à grande échelle.

Questionnaires et sondages : l’art de la mesure à grande échelle

Les sondages massifs permettent de quantifier les comportements avec précision. Les formulaires numériques facilitent la récolte de gros volumes. C’est l’outil roi pour obtenir des statistiques exploitables rapidement. La standardisation garantit un traitement efficace des réponses obtenues.

La portée de ces outils est immense. Vous pouvez toucher des milliers de répondants en un clic. L’automatisation réduit les erreurs de saisie manuelles.

Visez la clarté. Un questionnaire simple obtient toujours de meilleurs taux de réponse.

Formulation des questions : le rempart contre les biais cognitifs

Les pièges sémantiques faussent souvent les réponses. Une question mal tournée oriente le participant malgré lui. L’objectivité doit rester votre priorité absolue.

Proposez des structures neutres et équilibrées. L’ordre des interrogations influence aussi la psychologie du répondant. Évitez de créer un tunnel de pensée prévisible.

Testez vos questions sur un petit groupe. Cela permet de détecter les ambiguïtés avant le lancement officiel.

Analyse des erreurs de conception : le naufrage des formulaires mal nés

Les fautes structurelles rendent souvent un questionnaire totalement inutilisable. Une ergonomie défaillante provoque l’abandon immédiat des répondants. Il faut soigner l’expérience utilisateur dès le départ. Un protocole flou génère des données inexploitables ou erronées.

En voici les symptômes cliniques :

- Questions trop longues

- Absence d’option « Autre »

- Fautes d’orthographe

- Trop de champs obligatoires

Le test pilote est indispensable. Il valide la clarté de votre démarche globale.

Approches qualitatives : l’exploration des profondeurs humaines

Les chiffres révèlent les tendances, mais l’approche qualitative en dévoile les motivations profondes.

Entretiens et focus groups : la parole comme matière première

Les échanges verbaux captent les motivations réelles. L’entretien individuel permet une précision chirurgicale. Le focus group, lui, mise sur la dynamique collective.

Maîtrisez l’art de la relance pour extraire des confidences. Ne vous contentez pas de la première réponse. Creusez chaque point pour obtenir du sens.

L’empathie est votre meilleur outil. Elle libère la parole et révèle des insights souvent insoupçonnés.

Observation directe : le regard clinique sur le terrain

L’immersion physique enregistre les faits sans filtre déclaratif. Les gens mentent, mais leurs gestes ne trompent pas. Observez les comportements réels en situation.

Distinguez l’observation participante de la posture neutre. Chaque méthode a ses avantages propres. Le choix dépend de votre objectif de recherche final.

Notez les interactions avec le produit. Ces détails concrets valent souvent plus que de longs discours théoriques.

Analyse thématique : la transmutation du verbe en savoir

Le codage des données textuelles permet d’extraire des tendances fortes. Il transforme des témoignages épars en une structure cohérente. C’est un travail de patience et de rigueur. La subjectivité de l’enquêteur doit être encadrée par des grilles strictes.

Identifiez les thèmes récurrents dans les verbatims. Regroupez les idées similaires pour dégager des axes majeurs. Cette étape donne de la valeur à vos entretiens.

La validation croisée renforce la crédibilité. Comparez vos analyses avec d’autres experts.

Cycle de vie de la donnée : de la capture au raffinement

La donnée brute collectée doit subir une transformation méthodique pour devenir exploitable.

Préparation et stratégie : le plan de bataille avant l’action

Structurez vos objectifs avant toute intervention. Définissez les variables critiques pour éviter l’infobésité. Un plan clair garantit une exécution sans accroc.

Anticipez les besoins techniques de stockage. La donnée doit être rangée dès sa naissance. Cela facilite grandement les analyses futures de votre équipe.

Choisissez vos outils avec soin. La compatibilité entre les systèmes est un facteur de succès déterminant.

Nettoyage et validation : l’épuration nécessaire des scories numériques

Établissez des protocoles de dédoublonnage rigoureux. Les bases de données doivent être assainies régulièrement. La qualité prime toujours sur la quantité brute.

Éliminez les valeurs aberrantes qui polluent vos statistiques. Harmonisez les formats de saisie pour fusionner vos sources. C’est une étape ingrate mais indispensable.

Une donnée propre est une donnée fiable. Ne sautez jamais cette phase sous peine de conclusions fausses.

Transformation en KPI : la métamorphose de la donnée en pouvoir décisionnel

Orientez la donnée nettoyée vers des indicateurs de performance actionnables. Créez des ponts solides entre les chiffres et la stratégie. Un bon KPI doit provoquer une action immédiate. La clarté des tableaux de bord justifie tout l’investissement.

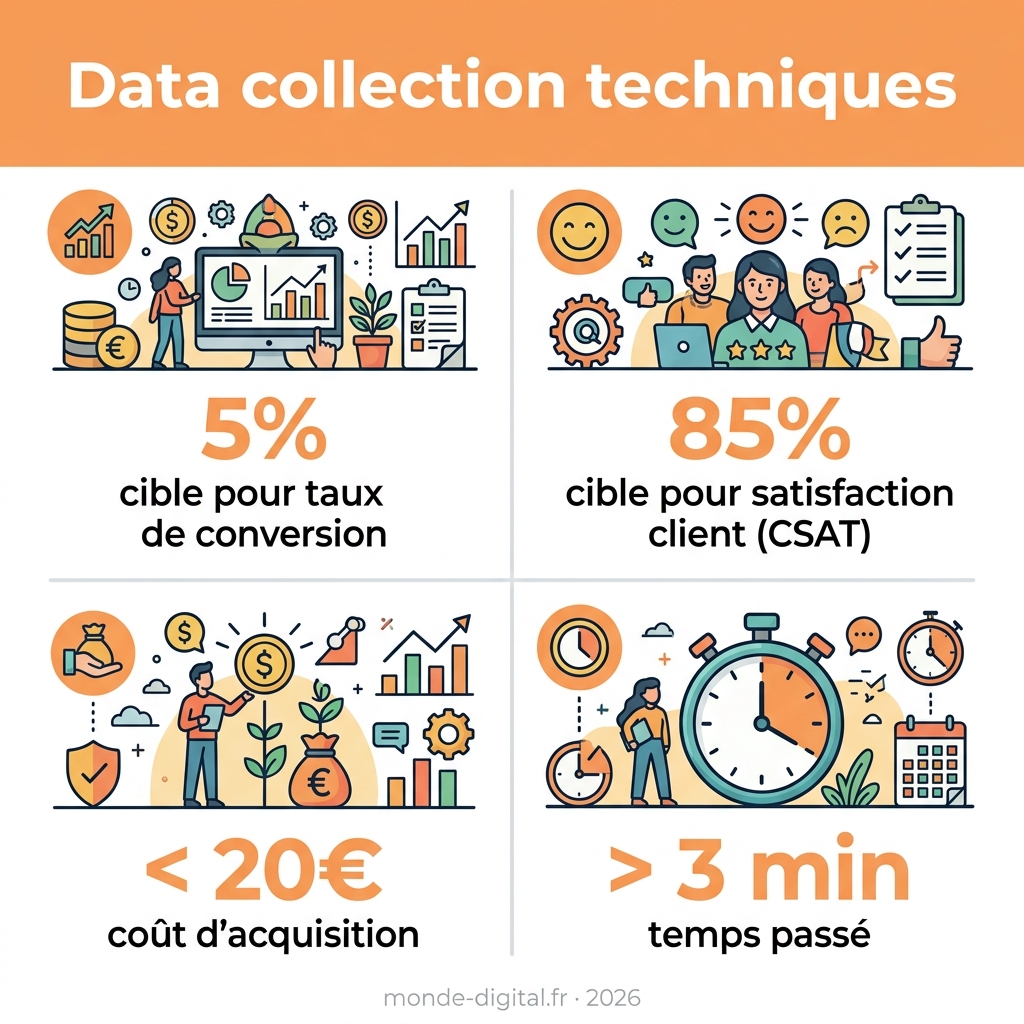

| Métrique | Type de donnée | Objectif stratégique | Fréquence de suivi |

|---|---|---|---|

| Taux de conversion | Pourcentage | Optimiser les ventes (cible 5%) | Hebdomadaire |

| Satisfaction client | Score (CSAT) | Fidéliser l’audience (cible 85%) | Mensuelle |

| Coût d’acquisition | Financier (€) | Rentabiliser le marketing (< 20€) | Mensuelle |

| Temps passé | Temporel (min) | Mesurer l’engagement (> 3 min) | Quotidienne |

| Taux de rebond | Pourcentage | Améliorer la pertinence (< 40%) | Hebdomadaire |

| Revenu par utilisateur | Financier (€) | Maximiser la valeur (cible 15€) | Trimestrielle |

Communiquez vos résultats simplement. L’adhésion des équipes dépend de la lisibilité des chiffres.

Éthique et souveraineté : le bouclier du RGPD et de la vie privée

La performance technique ne doit jamais faire oublier le cadre légal et le respect de l’utilisateur.

Conformité réglementaire : l’impératif catégorique de la protection

Respectez les obligations légales du RGPD. Sécurisez le consentement explicite de chaque participant. C’est le seul moyen d’éviter des sanctions lourdes.

Intégrez la protection des données dès la conception. La sécurité n’est pas une option ajoutée après coup. Elle doit être intégrée au système.

Nommez un responsable interne pour ces questions. La vigilance constante protège votre réputation et vos actifs numériques.

Gamification et données zero-party : le pacte de confiance volontaire

Utilisez des mécanismes ludiques pour inciter au partage. L’utilisateur donne ses informations de son plein gré. C’est ce qu’on appelle la donnée zero-party.

Valorisez l’échange de valeur entre vous et l’utilisateur. Offrez un bénéfice concret en contrepartie du temps accordé. La confiance se gagne par la transparence.

Récoltez des préférences précises sans traceurs intrusifs. C’est une approche beaucoup plus saine pour votre relation client.

Transparence et expérience utilisateur : la fin de la collecte prédatrice

Conciliez vos besoins de connaissance avec le respect de l’intimité. Communiquez clairement sur l’usage futur des informations récoltées. Réduisez la friction lors de la saisie pour aider le répondant. Une expérience fluide garantit un meilleur taux de complétion.

Soyez honnête sur vos intentions. Le lecteur apprécie la franchise et sera plus enclin à collaborer.

Évitez les formulaires interminables. Allez à l’essentiel pour ne pas lasser votre audience dès les premières secondes.

Arsenal technologique : l’automatisation au service de la performance

Pour passer à l’échelle, l’humain doit s’appuyer sur des outils capables de traiter l’information en continu.

CRM et centralisation : l’unification des flux de connaissances

Utilisez votre CRM comme un véritable coffre-fort de savoir. Centralisez toutes les interactions client en un seul point. C’est la base d’une vision unifiée.

Brisez les silos d’information entre vos différents services internes. Automatisez la mise à jour des profils pour garder des données fraîches. Une connaissance client à 360 degrés permet des actions marketing ultra-ciblées. Ne laissez aucune information dormir dans un fichier isolé.

La synchronisation en temps réel est votre alliée. Elle évite les doublons et les erreurs de communication embarrassantes.

Web scraping et données publiques : le pillage organisé de l’Open Data

L’extraction automatisée permet de surveiller la concurrence efficacement. Transformez le web en un laboratoire d’observation géant. C’est une source d’informations publiques inépuisable.

Respectez les limites éthiques du moissonnage de sites web. Ne saturez pas les serveurs cibles par gourmandise. La politesse technique est aussi une règle.

Les data collection techniques modernes reposent sur l’acquisition de :

- Prix des concurrents

- Tendances de recherche

- Annuaires publics

- Réseaux sociaux professionnels

Workflows automatisés : la machine de collecte en mouvement perpétuel

Déployez des chaînes de traitement sans intervention humaine. La collecte continue assure une réactivité maximale. Votre entreprise reste ainsi à l’écoute du marché.

Connectez vos outils de formulaire directement à vos systèmes d’analyse. Les signaux faibles sont détectés immédiatement par vos algorithmes. Cela libère du temps pour vos équipes créatives. La machine s’occupe de la répétition, vous gardez l’interprétation.

L’automatisation réduit drastiquement le coût. C’est un investissement rentable sur le long terme.

L’arbitrage entre sources primaires et secondaires, la rigueur de l’échantillonnage et l’éthique du RGPD forgent votre souveraineté décisionnelle. L’automatisation des flux transforme le chaos brut en indicateurs de performance exploitables. Reste à intégrer ces techniques dans votre organisation pour anticiper les mutations du marché avant vos concurrents.

FAQ

Quelle est la distinction fondamentale entre les données primaires et secondaires ?

L’arbitrage entre ces deux piliers est une question de souveraineté informationnelle. Les données primaires sont forgées pour un dessein spécifique, captées à la source même par des enquêtes ou des observations directes. Elles offrent une pureté et une exclusivité tactique, bien que leur conquête exige un investissement temporel et financier substantiel.

À l’opposé, les données secondaires constituent des gisements préexistants, tels que des rapports officiels ou des archives administratives. Si leur accessibilité immédiate accélère la décision, elles portent en elles le stigmate de l’obsolescence potentielle et un manque de spécificité qui peut entraver l’analyse de précision.

Comment garantir la représentativité d’un échantillon lors d’une collecte ?

La vérité statistique ne tolère aucune approximation ; elle repose sur la rigueur de l’échantillonnage probabiliste. Qu’il s’agisse d’un tirage aléatoire simple ou d’une stratification par sous-groupes homogènes, l’objectif demeure l’éradication des biais de sélection. Un échantillon trop exigu ou mal ciblé condamne vos conclusions à l’effondrement face à la réalité du terrain.

La détermination de la taille critique doit intégrer des variables complexes telles que la marge d’erreur, le niveau de confiance et l’effet du plan de sondage (deff). Sans ce bouclier méthodologique, la collecte de données n’est qu’un simulacre de science, incapable de soutenir une stratégie de puissance.

Quelles sont les méthodes privilégiées pour l’analyse des données qualitatives ?

L’exploration des profondeurs humaines exige un arsenal analytique capable de transmuter le verbe en savoir. L’analyse thématique s’impose pour identifier des modèles récurrents dans les témoignages, tandis que l’analyse narrative s’attache à décrypter la complexité des histoires vécues par les sujets. Ces méthodes permettent de sonder les motivations réelles là où les chiffres restent muets.

Pour ceux qui cherchent à bâtir des théories à partir du réel, l’analyse de la théorie ancrée offre une approche inductive impitoyable. Enfin, l’analyse du discours permet de saisir le sens profond des échanges en les replaçant dans leur contexte social, révélant ainsi les structures de pensée.

Pourquoi le nettoyage des données est-il une étape non négociable ?

Accumuler des informations sans protocole d’épuration est une faute stratégique majeure menant à l’infobésité. Le nettoyage permet d’éliminer les valeurs aberrantes et les doublons qui polluent vos systèmes. Une base de données corrompue par des scories numériques ne produira que des KPI fallacieux, entraînant des décisions potentiellement désastreuses.

La validation et l’harmonisation des formats transforment la donnée brute en un actif fiable et actionnable. C’est dans ce raffinement ingrat que réside la véritable valeur ajoutée, garantissant que chaque indicateur de performance repose sur un socle de vérité inattaquable.

Comment concilier performance de collecte et respect du RGPD ?

La conformité réglementaire n’est pas un obstacle, mais un impératif catégorique de protection de vos actifs. Le respect du RGPD impose une transparence totale et l’obtention d’un consentement explicite. En intégrant la sécurité dès la conception des outils de capture, vous érigez un rempart contre les sanctions et préservez votre réputation.

L’émergence des données zero-party, collectées via des mécanismes de gamification ou d’échanges de valeur volontaires, marque la fin de la collecte prédatrice. Ce pacte de confiance entre l’organisation et l’individu assure une qualité d’information supérieure tout en respectant l’intimité numérique des participants.